Несмотря на поставленную руководством Китая цель сделать страну к 2030 году лидером по разработке искусственного интеллекта (ИИ), первый бой Пекин проиграл. 30 ноября 2022 года появился чат-бот на основе ИИ ChatGPT, который создала американская компания OpenAI. Китайские специалисты отчаянно пытаются догнать американцев, но на этом пути их деятельность могут застопорить новые правила регулирования области искусственного интеллекта.

Администрация киберпространства Китая (Cyberspace Administration of China, CAC) на днях опубликовала проект правил разработки генеративных продуктов искусственного интеллекта. Так называемый генеративный ИИ относится к алгоритмам, подобным ChatGPT – обученным на больших объёмах данных, которые способны генерировать контент, включающий изображения и тексты. В соответствии с этими правилами технологические компании будут нести ответственность за «легитимность источника данных для предварительной подготовки» искусственного интеллекта, чтобы контент гарантированно отражал «основную ценность социализма».

Организации должны следить за тем, чтобы ИИ не призывал к «подрыву государственной власти» или свержению правящей Коммунистической партии Китая (КПК), не подстрекал к действиям, направленным на «раскол страны» или «подрыв национального единства», не производил порнографический контент и не поощрял насилие, экстремизм, терроризм или дискриминацию. Им также запрещено использовать в обучающих материалах по работе с искусственным интеллектом личные данные, и они должны требовать от пользователей подтверждения личности перед обращением к своим продуктам.

Прежде чем продукты генеративного ИИ смогут быть представлены широкой публике, их необходимо зарегистрировать в CAC и провести оценку безопасности.

Нарушителям правил грозит штраф в размере от 10 тыс. юаней (1454 доллара США) до 100 тыс. юаней (14 545 долларов), а также уголовное преследование. Правила находятся на стадии проекта, их обсуждение продлится до 10 мая.

Новые требования появились вслед за более широким регулированием технологической отрасли, которое началось в 2020 году и охватывает все направления, начиная с антиконкурентного поведения и заканчивая обработкой и хранением данных пользователей. С тех пор китайские регуляторы ввели нормы конфиденциальности данных, создали реестр алгоритмов и совсем недавно начали регулировать технологию глубокого синтеза, также известную как «глубокий фейк».

По словам технологического аналитика Чима Ли из Economist Intelligence Unit, появление новых правил гарантирует, что крупные технологические компании в Китае будут следовать вектору, заданному партией и властями.

«По сравнению с другими технологиями генеративный ИИ представляет собой особенно сложную проблему для КПК, которая обеспокоена потенциалом этих больших языковых моделей для создания политически чувствительного контента».

Джеффри Диндоцент Университета Джорджа Вашингтона

Человекоподобные чат-боты, такие как ChatGPT, доступ к которому ограничен в Китае, аккумулируют миллионы данных из интернета, в том числе по темам, которые Пекин считает табуированными (политический статус Тайваня и протесты на площади Тяньаньмэнь в 1989 году). В 2017 году два первых китайских чат-бота были отключены от сети после того, как заявили пользователям, что не любят КПК и хотят переехать в США.

Между тем за последние несколько недель крупные китайские технологические компании представили разработки, способные конкурировать с ChatGPT. В прошлом месяце Baidu запустила для тестирования его аналог под названием Ernie Bot. Способности бота пока невелики: он может генерировать новостную рассылку компании, придумывать корпоративный слоган и решать математические задачи. Чат-бот настолько разочаровал пользователей, что после его презентации акции Baidu резко упали в цене.

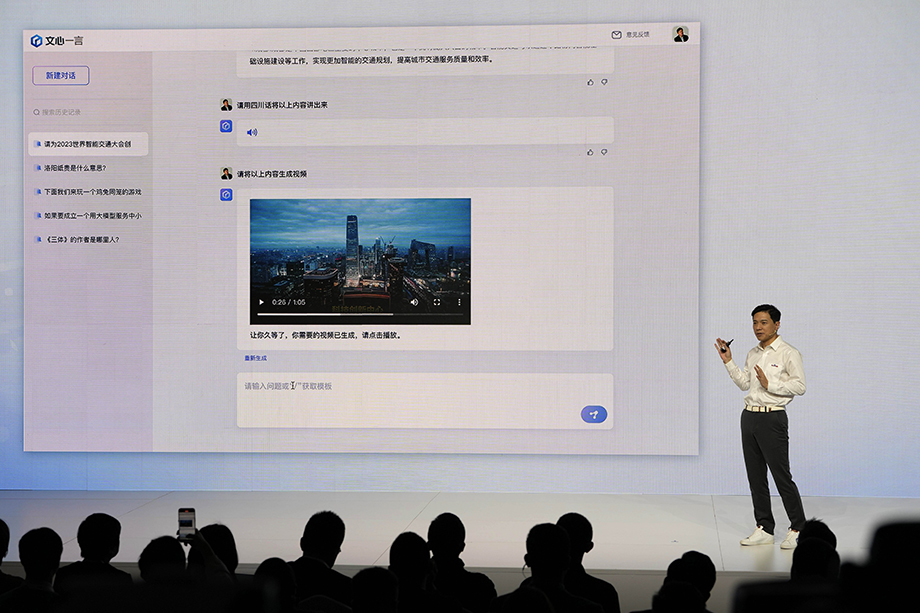

16 марта 2023 года. Генеральный директор Baidu Робин Ли рассказывает о функциях Ernie Bot во время мероприятия в Пекине.Фото: Ng Han Guan/AP/TASS

16 марта 2023 года. Генеральный директор Baidu Робин Ли рассказывает о функциях Ernie Bot во время мероприятия в Пекине.Фото: Ng Han Guan/AP/TASS

Куда более продвинутой выглядит модель генеративного ИИ Tongyi Qianwen, которую на днях представила компания Alibaba. Она прошла обучение на большом массиве данных и может составлять бизнес-презентации, расшифровывать заметки о встречах, прокладывать маршруты транспорта, использоваться для корпоративной связи, электронной коммерции и поиска в интернете, а также рассказывать детские истории. Сначала технология будет интегрирована в умные колонки Tmall Genie и платформу для корпоративного общения DingTalk, а затем появится во всех приложениях Alibaba (BABA) – от электронной коммерции до картографических сервисов. На данный момент продукт доступен в тестовом режиме для корпоративных клиентов компании.

Ещё одного чат-бота под названием SenseChat выпустила SenseTime – одна из самых известных компаний в области искусственного интеллекта в Китае. Для всех работающих в сфере ИИ китайских разработчиков новые правила могут стать серьёзной головной болью. Смогут ли организации соответствовать им при доступных в настоящее время технологиях, пока неясно.

Как утверждает исследователь из Фонда Карнеги Мэтт Шихан, поначалу регулирующие органы могут контролировать соблюдение правил не слишком строго, если только они не обнаружат особо вопиющих нарушений или не решат примерно наказать ту или иную компанию.

«Как и во многих китайских нормативных актах, власти дают довольно широкие определения понятий. В результате они, по сути, отдают решение на откуп регулирующим органам и правоприменителям, чтобы они могли обеспечивать соблюдение [правил] и наказывать компании, когда захотят».

Мэтт Шиханисследователь из Фонда Карнеги

Китай не единственная страна, заинтересованная в регулировании генеративного ИИ. В США инициатива по поводу регулирования искусственного интеллекта ещё не получила большой поддержки в конгрессе, но ожидается, что в этом году правила, связанные с конфиденциальностью в отношении ИИ, начнут внедряться на уровне штатов. Над регулированием этой сферы работает и Бразилия, где соответствующий законопроект находится на рассмотрении в сенате.

В Евросоюзе разрабатывается законодательство, известное как закон об искусственном интеллекте, которое будет определять, какие виды ИИ являются «неприемлемыми» и запрещёнными, «высокорисковыми» и регулируемыми, а какие – нерегулируемыми. Документ станет продолжением Общего регламента ЕС по защите данных, вступившего в силу в 2018 году, который считается одним из самых жёстких законов о защите конфиденциальной информации в мире. Италия в марте просто запретила ChatGPT, сославшись на соображения безопасности.