В то время как администрация президента США Джо Байдена и Пекин продолжают размышлять о будущем регулирования искусственного интеллекта (ИИ), европейские законодатели завершили начальный этап работы над первым в западном мире сводом соответствующих правил. Два комитета Европарламента одобрили компромиссный текст закона об искусственном интеллекте, который серьёзно ограничивает возможности последнего. Но уверенности в том, что документ будет принят в нынешнем виде, нет.

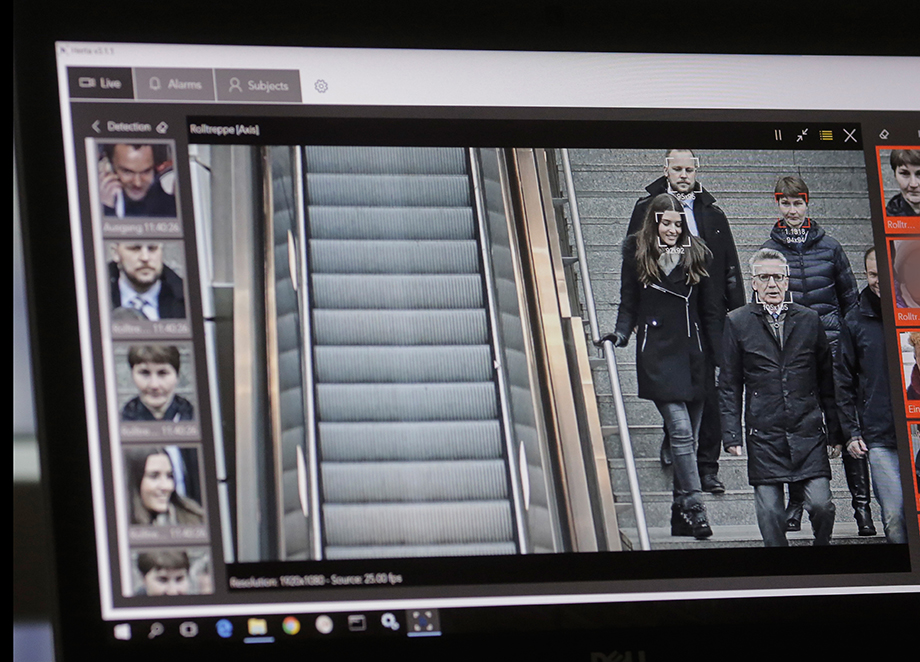

Депутаты Европарламента приняли решение о полном запрете на дистанционную биометрическую идентификацию – распознавание лиц, распознавание людей на фотографиях или видеозаписях – как в режиме реального времени, так и постфактум. Правоохранительным органам, пограничным службам, работодателям и представителям сферы образования запрещено использовать программное обеспечение для распознавания эмоций.

Этот вопрос вызвал среди законодателей нешуточные споры, поскольку применение систем биометрической идентификации в определённых ситуациях, таких как похищение людей или теракты, было разрешено. Против полного запрета на распознавание лиц выступила Европейская народная партия, одна из крупнейших представленных в Европарламенте. Её представители сопротивлялись принятию этого пункта закона до последней минуты и, как ожидается, ещё не раз выступят против него в ходе предстоящих дебатов на более высоких уровнях.

Закон об искусственном интеллекте был впервые предложен Европейской комиссией в апреле 2021 года, задолго до бума на рынке чат-ботов.

Сейчас к первоначальному тексту документа добавлены новые положения, в первую очередь дополнительные обязательства, касающиеся так называемых моделей генеративного ИИ, таких как разработанный компанией Open AI чат-бот ChatGPT.

Закон разделяет приложения на основе ИИ на группы по степени риска: неприемлемый риск, высокий риск, ограниченный риск и минимальный. Приложения с неприемлемым уровнем риска, которые могут нанести значительный ущерб безопасности пользователей или основным правам, будут полностью запрещены. Системы с высоким уровнем риска, применение которых может быть чревато тяжёлыми социальными последствиями, перед выходом на рынок должны будут пройти тщательную оценку, получить регистрацию в базе данных ЕС и иметь маркировку CE. И наоборот, к сервисам на базе искусственного интеллекта с низким и минимальным уровнем риска будут применяться более мягкие меры регулирования.

Самые горячие дискуссии шли о том, какие технологии в какой раздел будут помещены.

Например, следует ли считать высокорисковым и выносить в зону самых строгих правил регулирования искусственный интеллект общего назначения (GPAI), коим являются ChatGPT, новый чат-бот Bing от Microsoft и чат-бот Bard от Google.

Против включения ИИ общего назначения в группу высокого риска выступили крупные технологические компании и консервативный блок политиков, заявив, что это задушит инновации. Их оппоненты ответили, что исключение мощных систем искусственного интеллекта общего назначения из новых правил было бы сродни принятию регулирования социальных сетей, которое не распространяется на Facebook (принадлежит Meta, признанной экстремистской организацией и запрещённой в России) или TikTok. Сторонники регулирования GPAI настаивали на том, что реальное представление об особенностях обучения этих моделей, а также об их предвзятости и вреде, который они могут нанести, имеют только их разработчики.

В начале апреля более 50 учреждений и экспертов по искусственному интеллекту выступили с открытым письмом против исключения ИИ общего назначения из системы жёсткого регулирования ЕС.

«Рассмотрение искусственного интеллекта общего назначения как не связанного с высоким уровнем риска даёт свободу [действий] компаниям, находящимся в центре индустрии ИИ, которые принимают чрезвычайно важные решения о том, как формируются эти модели, как и на кого они будут работать, – говорит подписавшая письмо президент компании Signal Foundation Мередит Уиттакер. – Это освободит их от проверки, даже если этот ИИ общего назначения является основой их бизнес-модели».

Системы ИИ будут разделены на несколько уровней риска.Фото: Markus Schreiber/DPA/TASS

Системы ИИ будут разделены на несколько уровней риска.Фото: Markus Schreiber/DPA/TASS

Однако к критикам свободы чат-ботов не прислушались. Согласно компромиссному тексту закона, такие приложения не будут считаться высокорисковыми. Тем не менее разработчиков генеративных моделей ИИ обязали сообщать о том, что текст или другой продукт сгенерирован искусственным интеллектом. Кроме того, они должны предоставлять подробную сводку обучающих данных, подпадающих под действие закона об авторском праве.

Это, как уверяют представители европейской исследовательской группы Corporate Europe Observatory, результат лоббистских усилий крупных технологических корпораций из Силиконовой долины. По сведениям специалистов, корпорации использовали в том числе ряд скрытых тактик, таких как лоббирование через группы, которые утверждают, что представляют интересы стартапов, но получают финансирование от крупных технологических спонсоров. Также лоббирование велось через группу экспертов высокого уровня, которая была создана Еврокомиссией для информирования о разработке политики в области ИИ.

В группе, как выяснилось, доминировали представители отрасли, в том числе из Google.

Одобренный комитетами текст закона нельзя считать окончательным вариантом. Ожидается, что Европарламент проголосует за него на пленарном заседании в июне. Далее последуют трёхсторонние переговоры между законодателями, странами-членами и официальными лицами Европейской комиссии, известные как трилоги. И судя по тому, как развиваются события, включая недовольство Еврокомиссии запретом на распознавание лиц, от этих переговоров можно ожидать любых сюрпризов. Но вряд ли они коснутся американских технологических компаний.

Последнее относится не только к Microsoft и Google. Одной из крупных проблем в странах Евросоюза является деятельность компании по распознаванию лиц Clearview AI. Она собирает и продаёт фотографий людей из социальных сетей и с новостных сайтов без их согласия. Сейчас её база насчитывает почти 100 млрд изображений. Ходят настойчивые слухи, что 10 млрд из них – снимки европейцев.